Slik spotter du en "Deep Fake" Face-swapped Video

Nylig har Reddit nylig gjort nyheter med en subreddit i hvor folk bruker et maskinlæringsverktøy kalt "Deep Fake" til automatisk erstatte en persons ansikt med en annen i en video. Selvfølgelig, siden dette er internett, bruker folk det for to ting: falsk kjendisporno og setter inn Nicolas Cage i tilfeldige filmer.

Mens bytte av ansiktet på et fotografi har det alltid vært relativt enkelt, bytte andres ansikt i en video som brukes å være tidkrevende og vanskelig. Frem til nå er det hovedsakelig bare gjort av VFX-studioer for store budsjett Hollywood-filmer, hvor en skuespillerens ansikt er byttet ut på deres stunt-dobbelte. Men nå, med Deep Fake, kan alle med en datamaskin gjøre det raskt og automatisk.

Før du går videre, må du vite hva en Deep Fake ser ut. Sjekk ut SFW-videoen nedenfor, som er en samling av forskjellige kjendisbytteswapper, hovedsakelig med Nic Cage.

Deep Fake-programvaren fungerer ved hjelp av maskinlæring. Det er først trent med et målfelt. Forvrengte bilder av målet går gjennom algoritmen, og den lærer hvordan de skal korrigere dem for å ligne det uendrede målflaten. Når algoritmen blir deretter matet bilder av en annen person, antar de at de er forvrengt bilder av målet, og forsøker å korrigere dem. For å få video, opererer Deep Fake-programvaren på hver ramme individuelt.

Årsaken til at Deep Fakes har stort sett bare involvert skuespillere er at det er mye bilder av dem tilgjengelig fra forskjellige vinkler som gjør trening mer effektiv (Nicolas Cage har 91 skuespill på IMDB). Men i lys av hvor mye bilder og videoer folk legger ut på nettet, og at du egentlig bare trenger omtrent 500 bilder til å trene algoritmen, er det ingen grunn til at vanlige folk ikke kan målrettes, selv om det er sannsynligvis med litt mindre suksess. Spot a Deep Fake

Akkurat nå er Deep Fakes ganske enkelt å få øye på, men det blir vanskeligere når teknologien blir bedre. Her er noen av gaveene.

Rarlige ansikter.

I mange Deep Fakes ser ansiktene bare rart ut. Funksjonene strekker seg ikke perfekt, og alt ser ut til å være litt voksaktig som i bildet nedenfor. Hvis alt annet ser normalt ut, men ansiktet virker rart, er det sannsynligvis en Deep Fake. Flimring

. Et vanlig trekk ved dårlige Deep Fake-videoer er at ansiktet ser ut til å flimre og de opprinnelige funksjonene noen ganger popper inn i visning. Det er normalt mer opplagt på kantene i ansiktet eller når noe passerer foran den. Hvis det er merkelig flimring, ser du på en Deep Fake. Ulike organer.

Deep Fakes er bare ansiktsbytter. De fleste prøver å få en god kroppsmatch, men det er ikke alltid mulig. Hvis personen synes å være merkbart tyngre, lettere, høyere, kortere eller har tatoveringer de ikke har i virkeligheten (eller ikke har tatoveringer de har i det virkelige liv) er det en god sjanse for at det er falskt. Du kan se et veldig åpenbart eksempel nedenfor, hvor Patrick Stewarts ansikt har blitt byttet med J.K. Simmons i en scene fra filmen Whiplash. Simmons er vesentlig mindre enn Stewart, så det ser bare ut rart. Short Clips.

Akkurat nå, selv om Deep Fake-programvaren fungerer perfekt og skaper et nesten uutviklet ansiktsbytte, kan det bare virkelig gjøre det for kort mengde tid. Før for lenge vil et av problemene ovenfor begynne å skje. Derfor er de fleste Deep Fake klippene som folk deler, bare noen få sekunder, resten av filmen er ubrukelig. Hvis du har vist et veldig kort klipp av en kjendis, gjør du noe, og det er ingen grunn til at det er så kort, det er en anelse om at det er en Deep Fake. Ingen lyd eller dårlig lipsynkronisering.

The Deep Fake-programvaren justerer bare ansiktsfunksjoner; det gjør ikke magisk en person lyd som en annen. Hvis det ikke er lyd med klippet, og det er ingen grunn til at de ikke skal være lyd, er det en annen anelse du ser på en Deep Fake. På samme måte, selv om det er lyd, hvis de talte ordene ikke stemmer overens med de bevegelige leppene (eller leppene ser rart ut mens personen snakker som i klippet under), kan du likevel ha en Deep Fake. Utrolige Klipp

. Denne typen sier selvsagt, men hvis du får et virkelig utrolig klipp, er det en god sjanse for at du ikke skal tro på det. Nicolas Cage har aldri stjernespillet som Loki i en Marvel-film. Det ville være kult, skjønt. Dubious Kilder.

Som med falske bilder, hvor videoen angivelig kommer fra, er ofte en stor anelse om autentisiteten. Hvis New York Times kjører en historie om det, er det langt mer sannsynlig å være sant at noe du oppdager i et tilfeldig hjørne av Reddit. For tiden er Deep Fakes mer av en forferdelig nysgjerrighet enn et stort problem . Resultatene er enkle å få øye på, og mens det er umulig å godkjenne det som gjøres, forsøker ingen å passere Deep Fakes som ekte videoer.

Da teknologien blir bedre, vil de trolig være mye større problem. For eksempel kan overbevisende falsk opptak av Kim Jong Un erklære krig mot USA føre til stor panikk.

Slik blokkerer du enkelte personer fra Snapchat-historien din

Snapchat's Story-funksjonen er så populær at den er blitt revet av gang på gang av Facebook. Det er en fin måte å dele hva som skjer i livet ditt på en engangs måte. Problemet er, noen ganger er det ett eller to personer du ikke nødvendigvis vil se alt du legger inn. Kanskje det er din mor, eller en irriterende eks.

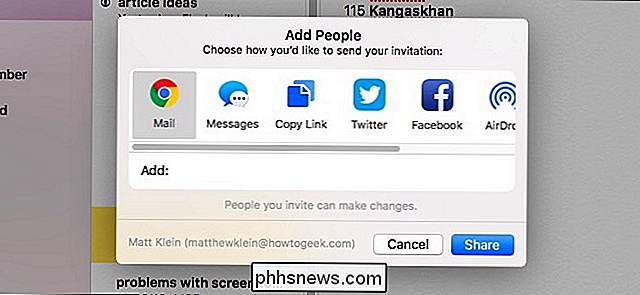

Slik oppretter og bruker du Google Photos 'nye delte biblioteker

Tilbake på Google I / O 2017, annonserte Google en ny funksjon i Google Photos kalt "Shared Libraries". I et nøtteskall kan brukerne raskt og enkelt dele bilder med andre, bestemte brukere automatisk. Denne funksjonen er nå live-her er alt du trenger å vite om å få det i gang. Hva er delte biblioteker?